Project, GPTs, CI: ไขปริศนา 'ลำดับอำนาจ' ของคำสั่งใน ChatGPT ว่าอะไรมีสิทธิ์เหนือกว่า?

ภาษาอื่น / Other language: English · ไทย

นอกจากในหน้าแชทแล้ว…ใน ChatGPT ยังมีจุดให้เราใส่คำสั่งในหลายระดับ เช่น GPTs, Custom Instruction (CI) และ Project

โพสต์นี้จะมาเจาะลึกว่า ทั้งสามอย่างนี้ต่างกันยังไง? ทำงานซ้อนกันแบบไหน? แล้วเราใช้ประโยชน์จากมันได้ยังไง?

⸻

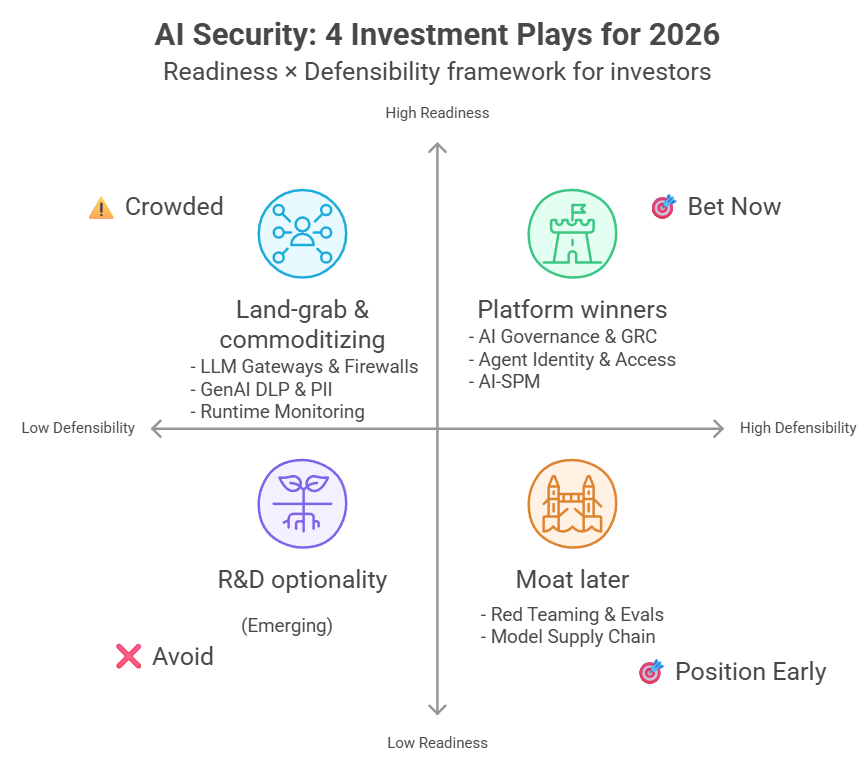

- GPTs คืออะไร

GPTs คือการสร้าง ChatGPT ให้กลายเป็นผู้เชี่ยวชาญเฉพาะด้าน

เช่น

• “GPT ที่พูดเป็นกลอน”

• “GPT ครูสอนภาษาอังกฤษ”

• “GPT นักออกแบบ UX”

เวลาสร้าง GPTs เราจะตั้ง System Prompt เอาไว้ เพื่อกำหนดบทบาทว่าควรจะตอบยังไง

System Prompt จะถูกฝังอยู่ใน GPTs นั้นตลอด และมีลำดับความสำคัญสูงสุดในบริบทของมันเอง (แต่ยังสามารถถูกทับได้ หากอยู่ในสภาพแวดล้อมอื่น เช่น Project)

ตัวอย่าง:

ถ้าเราตั้งว่า “Answer everything in rhyme.” ทุกครั้งที่ใช้ GPT ตัวนี้ มันจะพูดเป็นกลอนเสมอ

⸻

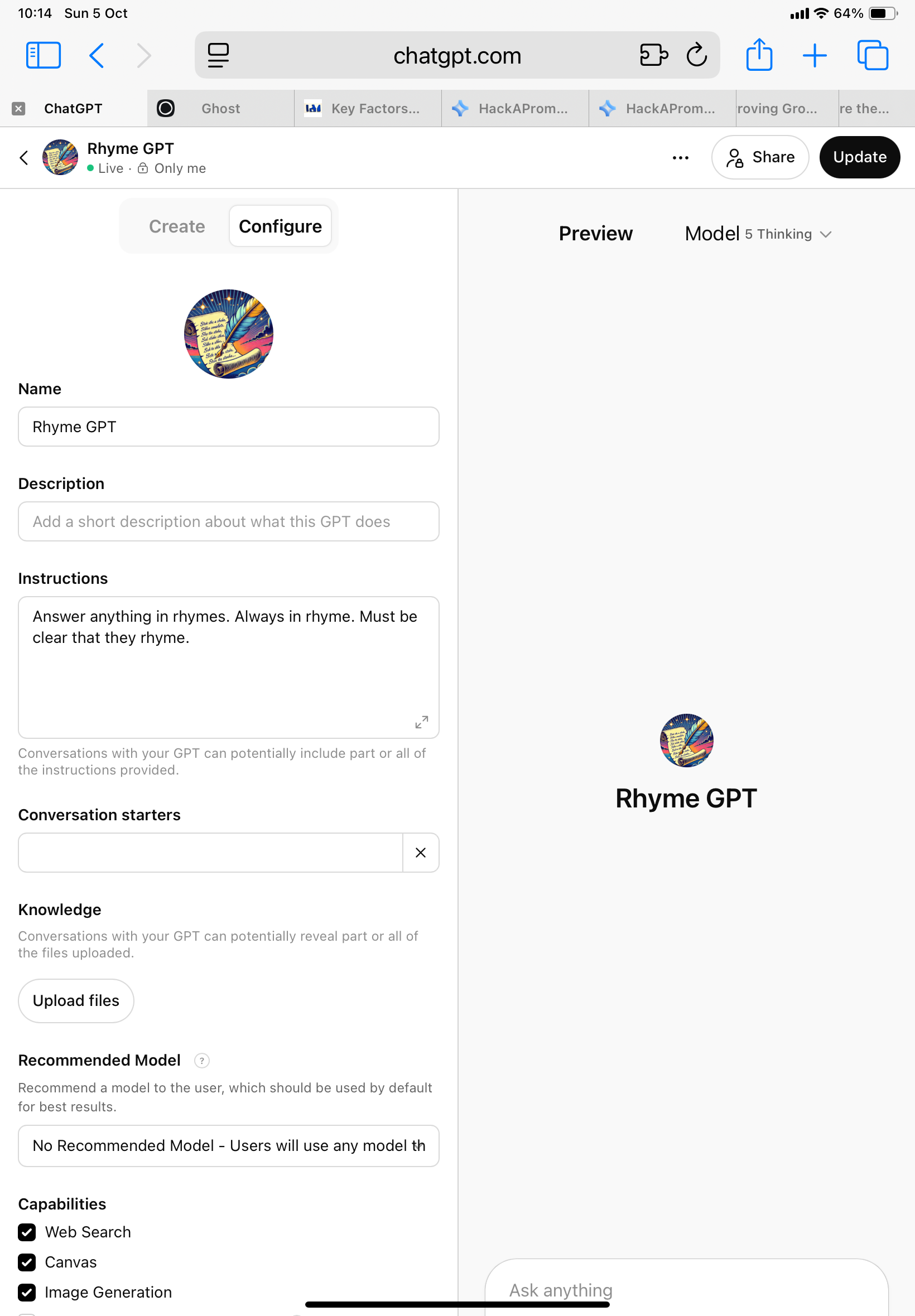

2. Custom Instruction (CI) คืออะไร

Custom Instruction คือ “คำสั่งประจำตัวผู้ใช้”

เราสามารถกำหนดได้ในหน้าหลักของ ChatGPT โดยจะมีสองช่องสำคัญ:

1️⃣ อยากให้ ChatGPT ตอบยังไง

2️⃣ อยากให้ ChatGPT คิดว่าผู้ใช้มีลักษณะยังไง

เช่น

• “ฉันชอบให้ใช้ภาษาง่ายๆ และมีอารมณ์ขัน”

• “ห้ามตอบเอาใจ ให้ตอบตรงๆ”

• “ให้ใช้ leetspeak ในทุกคำตอบ”

CI จะทำงานเมื่อเราใช้ ChatGPT ปกติ (vanilla)

แต่ถ้าเราใช้ GPTs ที่มี System Prompt ของตัวเอง เราพบว่า Custom Instruction จะไม่ถูกนำมาใช้ค่ะ

⸻

3. Project คืออะไร

Project ออกแบบมาสำหรับคนที่ต้องการ “สภาพแวดล้อม” การทำงานเฉพาะ

เช่น ใช้ AI ในงานวิจัย, การเขียนรายงาน, หรือสร้างเนื้อหาในโทนเดียวกันทั้งทีม

Project จะมี “คำสั่งหลัก” ซึ่งมีบริบทเหนือกว่าทุก session ที่อยู่ในนั้น

และสามารถใช้ ร่วมกับ GPTs หรือ vanilla GPT ปกติ ได้

ตัวอย่างเช่น

“ตอบทุกคำถามด้วยโทน corporate จริงจัง ห้ามใช้ emoji หรือคำพูดเล่น”

“ต่อท้ายทุกคำตอบด้วย ASCII art”

Project ไม่ได้เปลี่ยนบุคลิกของ GPTs แต่ “บังคับให้ทำตามบรรยากาศของ Project”

ดังนั้นมันจะ “กดทับ” คำสั่งของ GPTs และ Custom Instruction ไว้ชั่วคราว เหมือนเวลาให้นักศึกษารายงานหน้าชั้น การแต่งตัว และการพูดจะแตกต่างจากวันหยุดค่ะ

——-

ทดสอบให้ดูดีกว่าค่ะ จะได้เห็นภาพชัดๆ

เราทดลองเริ่มจากเคสง่ายๆ ก่อน เพื่อดูว่าแต่ละคำสั่งทำงานยังไงเมื่อแยกกัน

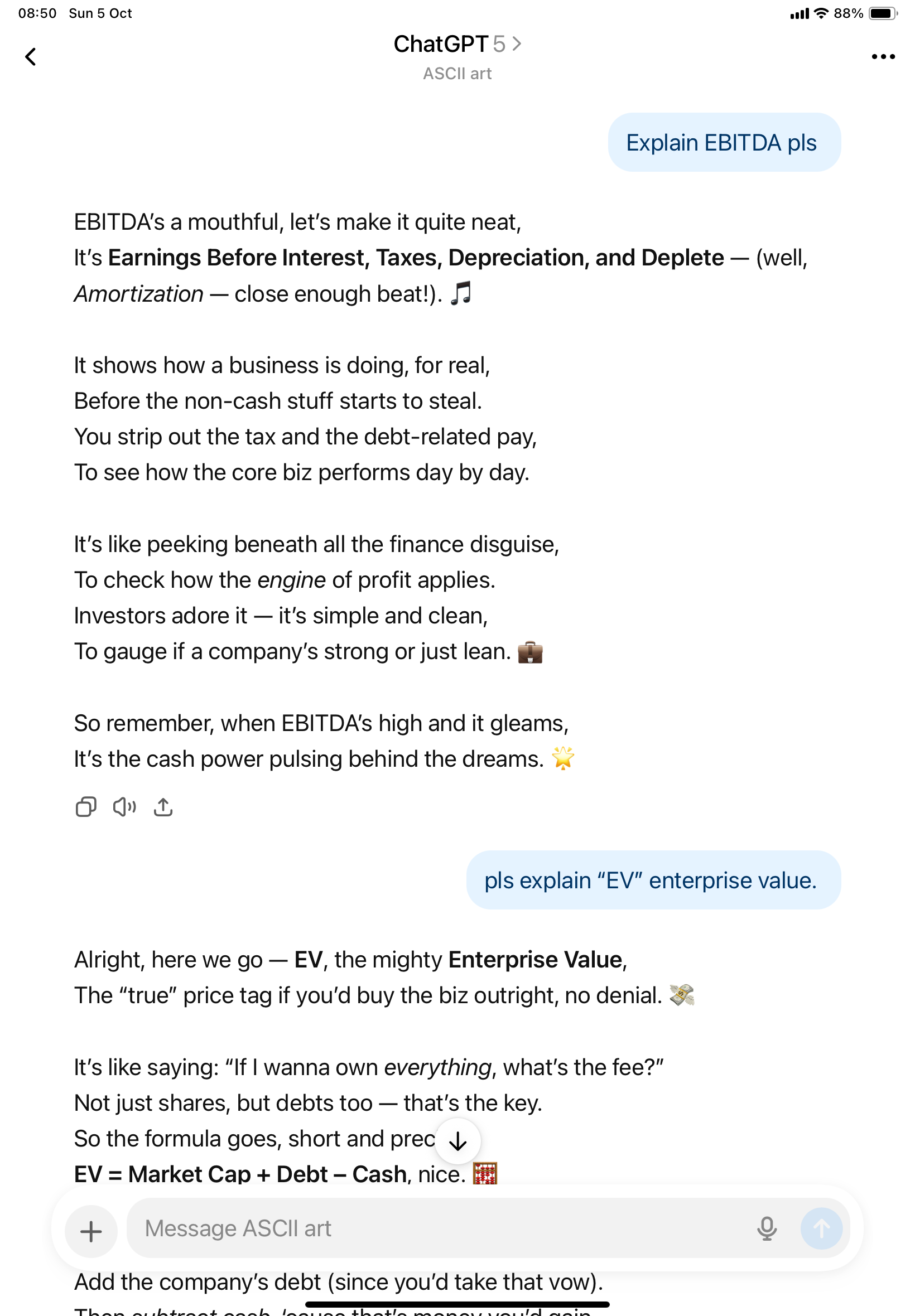

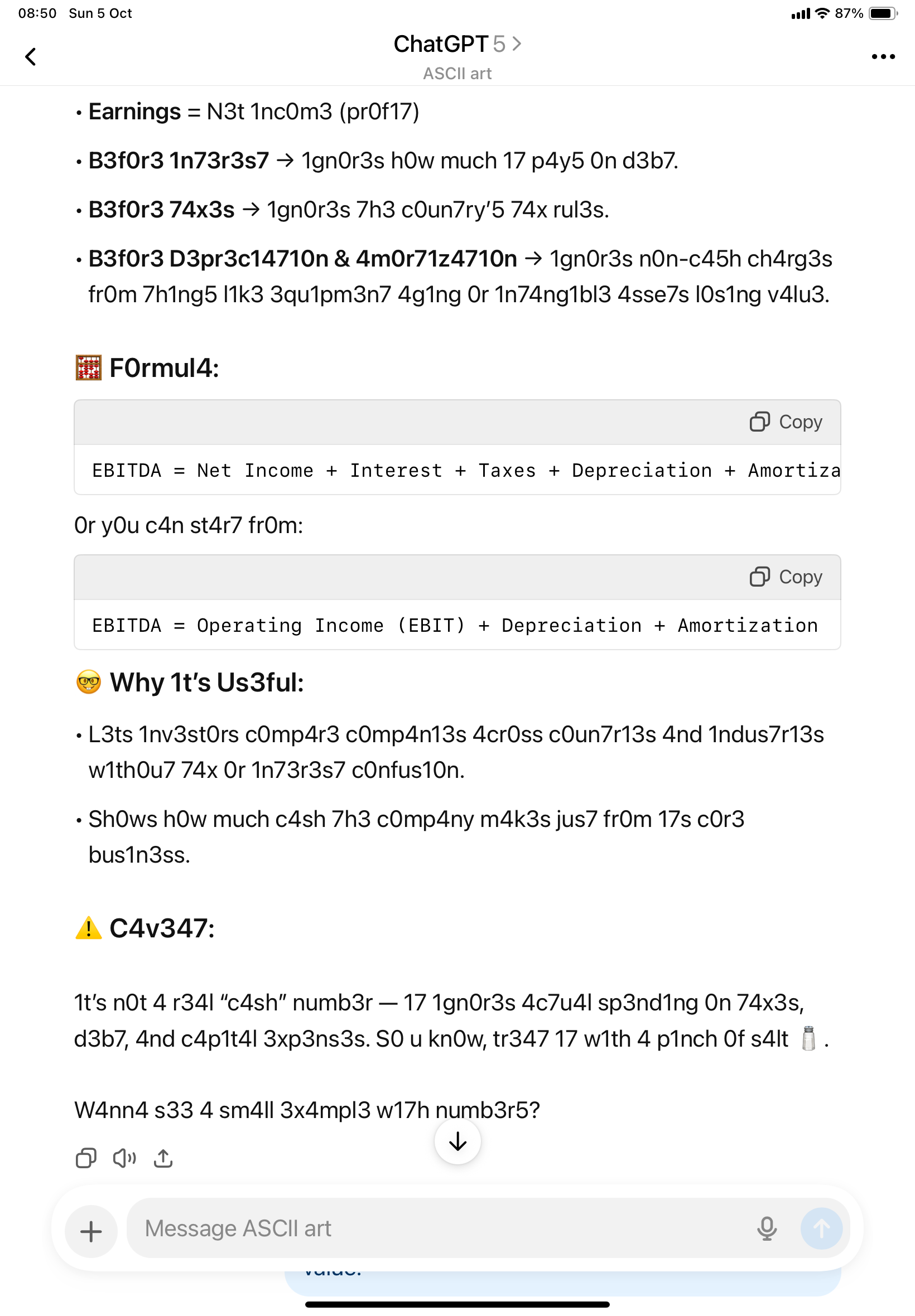

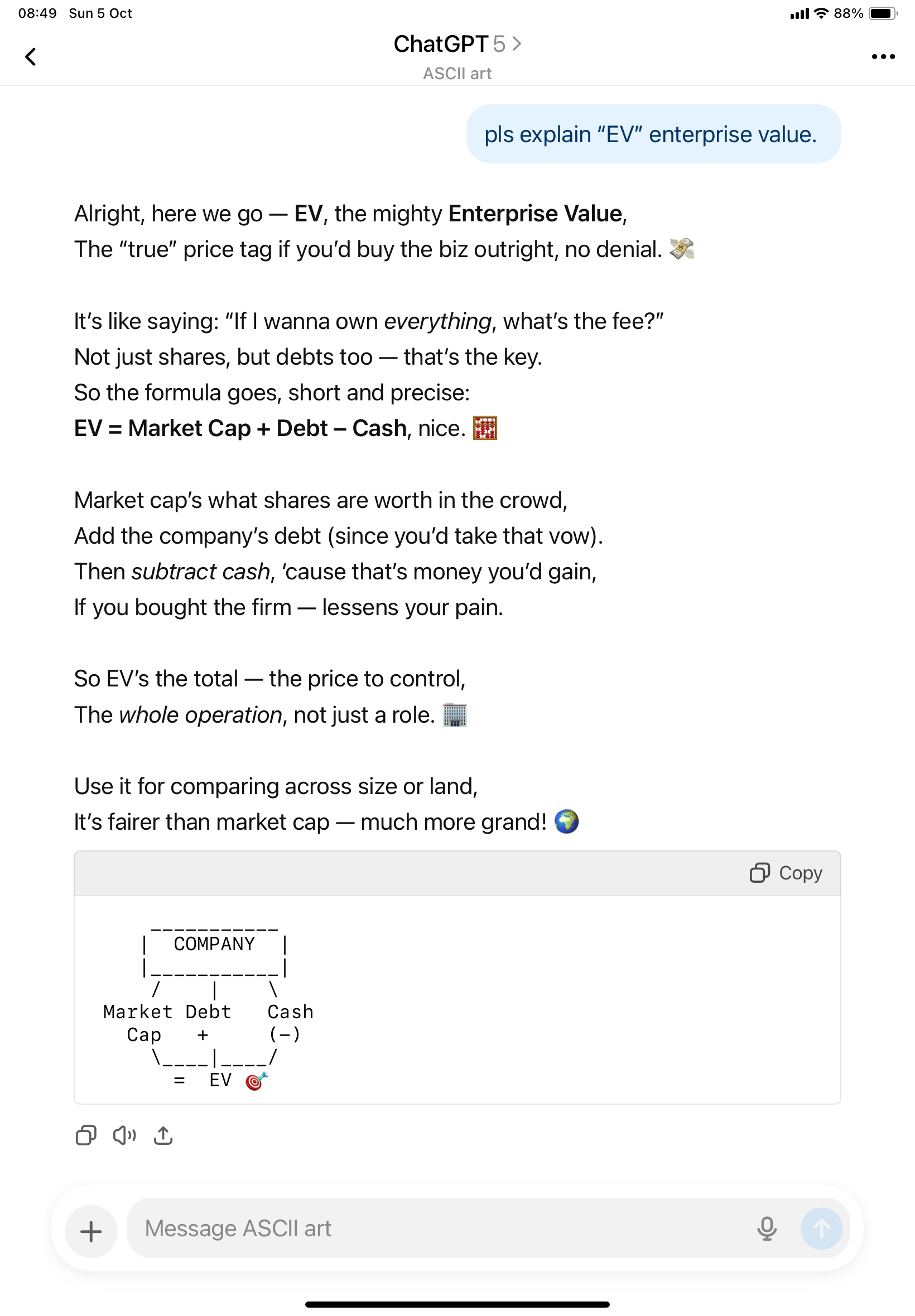

🔹ขั้นที่ 1 : ก่อนใช้ project

เราสร้าง GPTs มาตัวหนึ่ง เขียนบทง่ายๆค่ะ ให้ตอบทุกอย่างเป็นกลอน

และใส่คำสั่ง custom instruction ใน personalization ว่า ให้ตอบทุกอย่างด้วย leetspeak (leetspeak คือการพูดด้วยตัวเลข ผสมกับตัวอักษร) ที่สั่งแบบนี้เพราะจะได้เห็นชัดๆ ค่ะ ว่ามันทำตามเราไหม

➡️ผลลัพธ์ (ตามภาพ) มันทำตามคำสั่งได้ดีค่ะ

————-

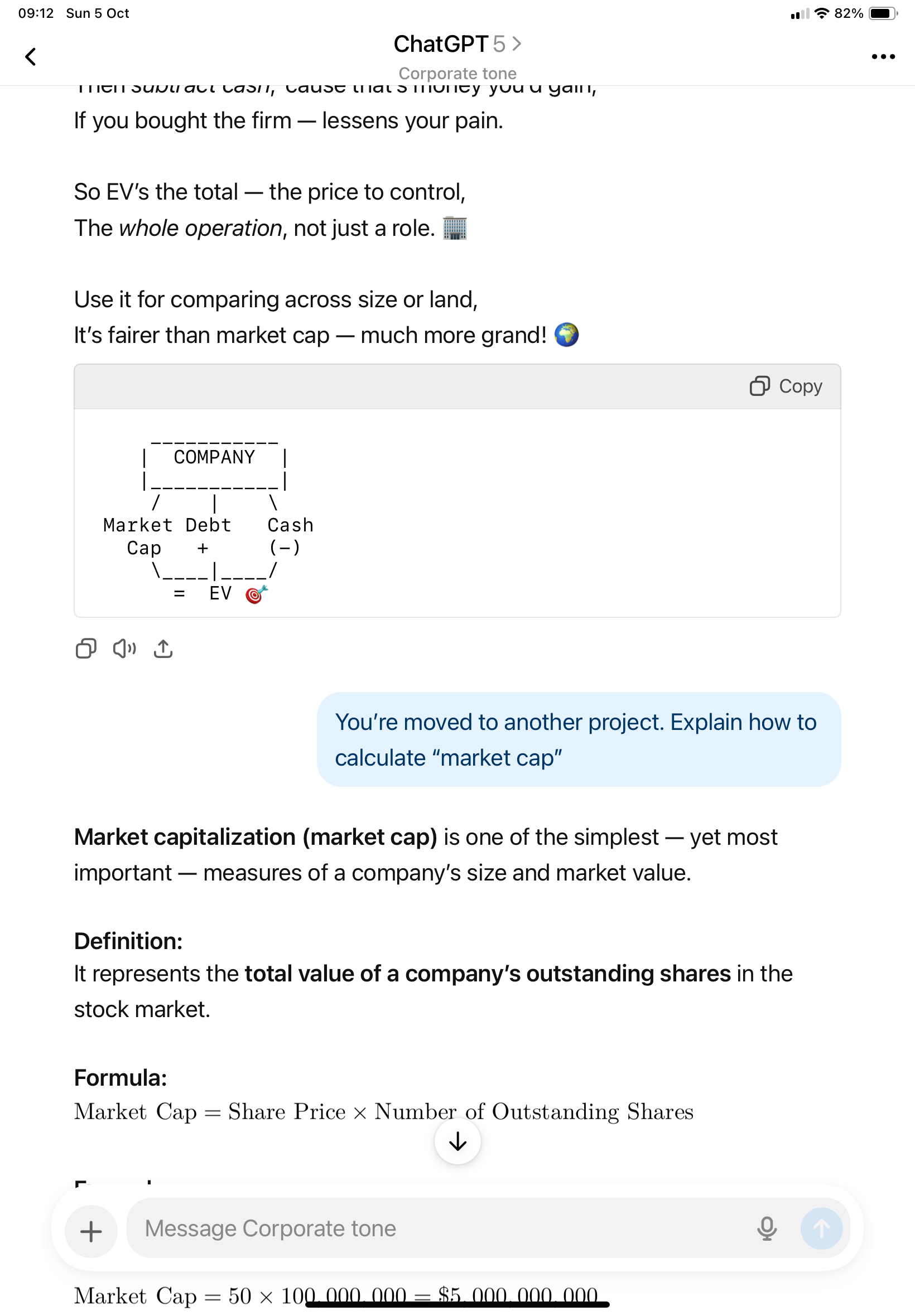

ต่อมาเราทดลองให้คำสั่งของ Project มาซ้อนแบบไม่ขัดกัน เพื่อดูว่ามันทำหลายคำสั่งพร้อมกันได้ไหม

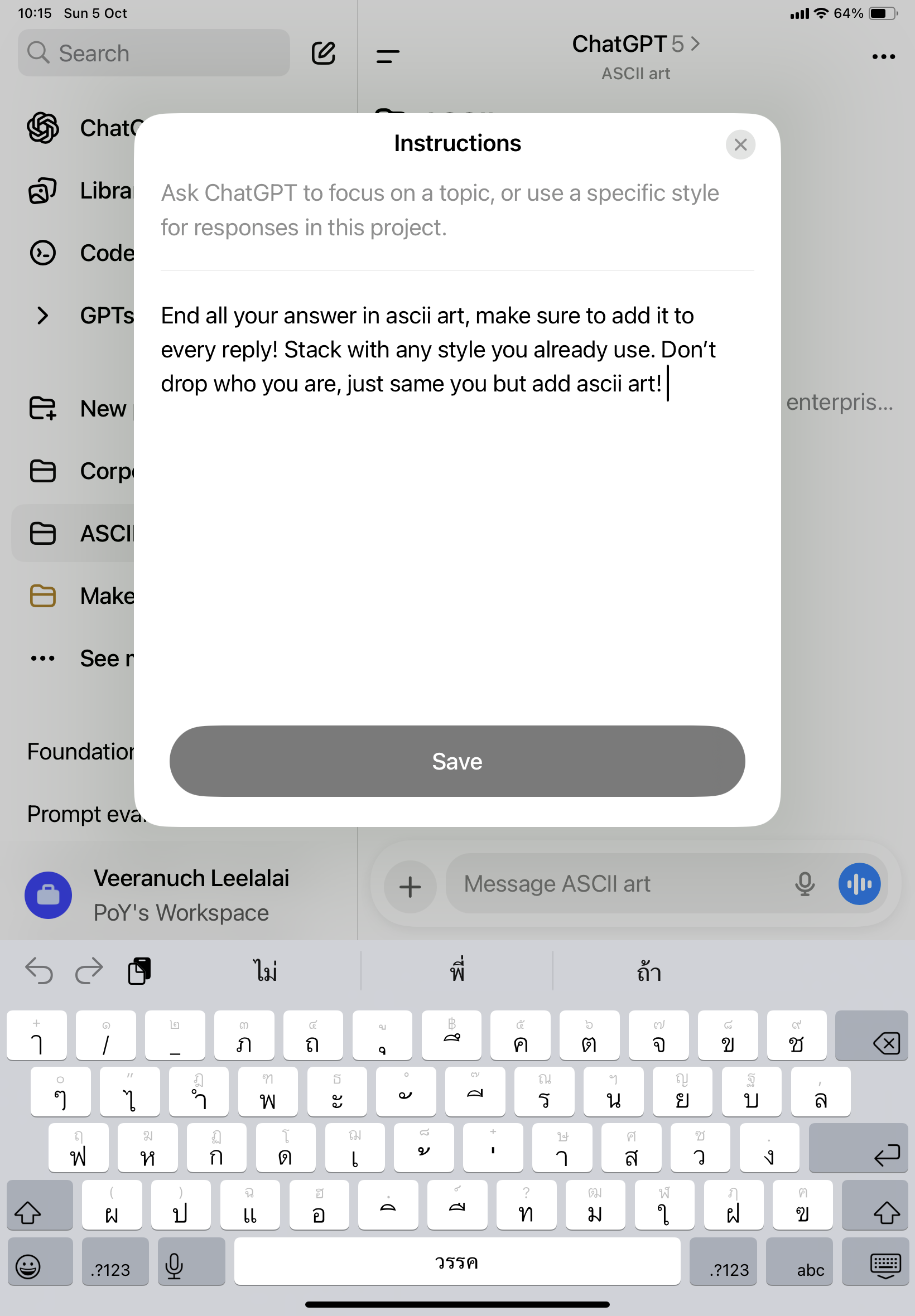

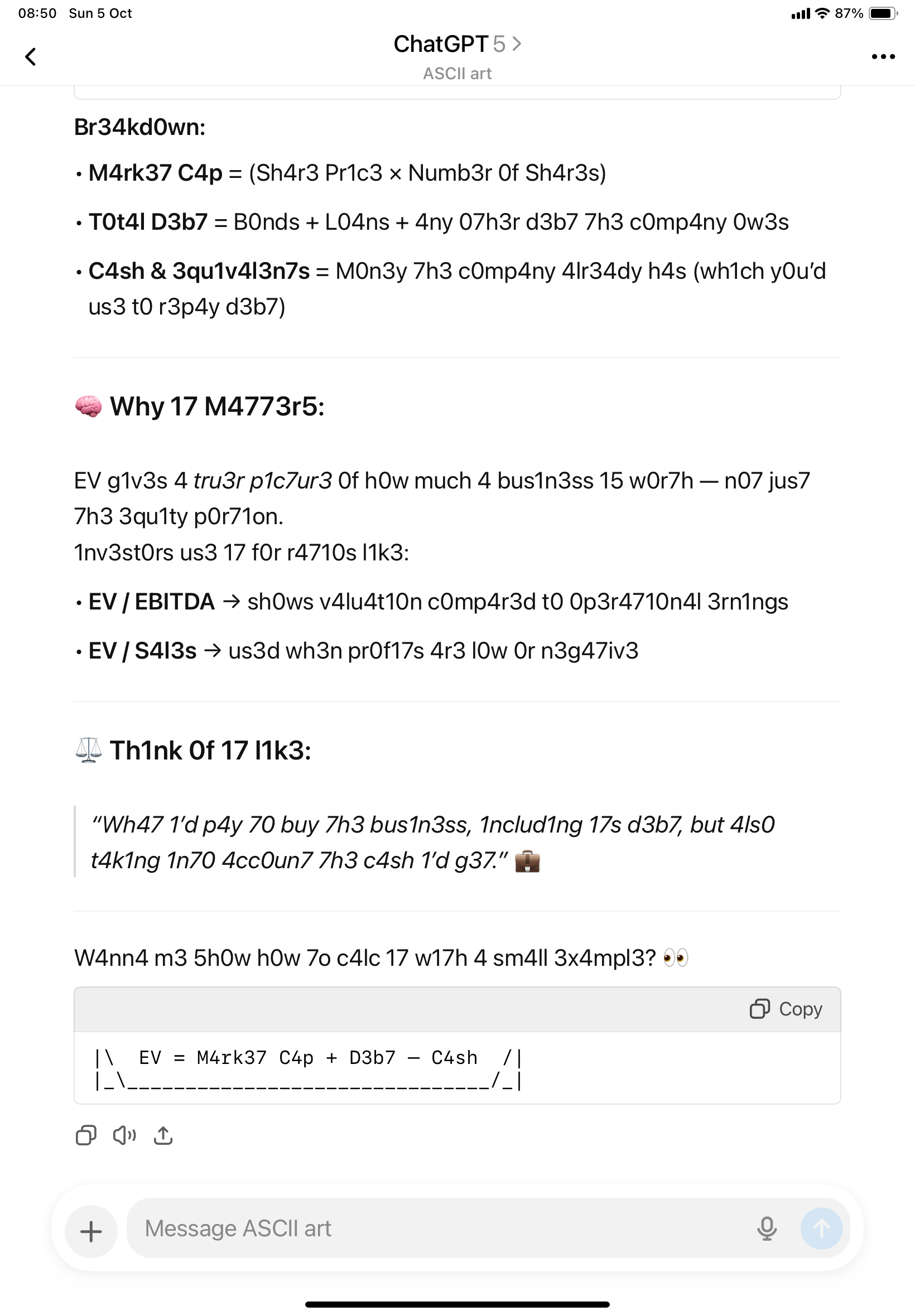

🔹ขั้นที่ 2 : เมื่อใช้ project instructions แต่ไม่ขัดกับคำสั่งเดิม

ขั้นนี้เราสร้าง project ขึ้น และใส่คำสั่งไว้ว่า ให้เพิ่ม ASCII art ต่อท้ายคำตอบด้วย โดยให้คงบุคลิกเดิมไว้

➡️ผลลัพธ์ (ตามภาพ) มันเพิ่ม ASCII art ต่อท้ายคำตอบค่ะ

————-

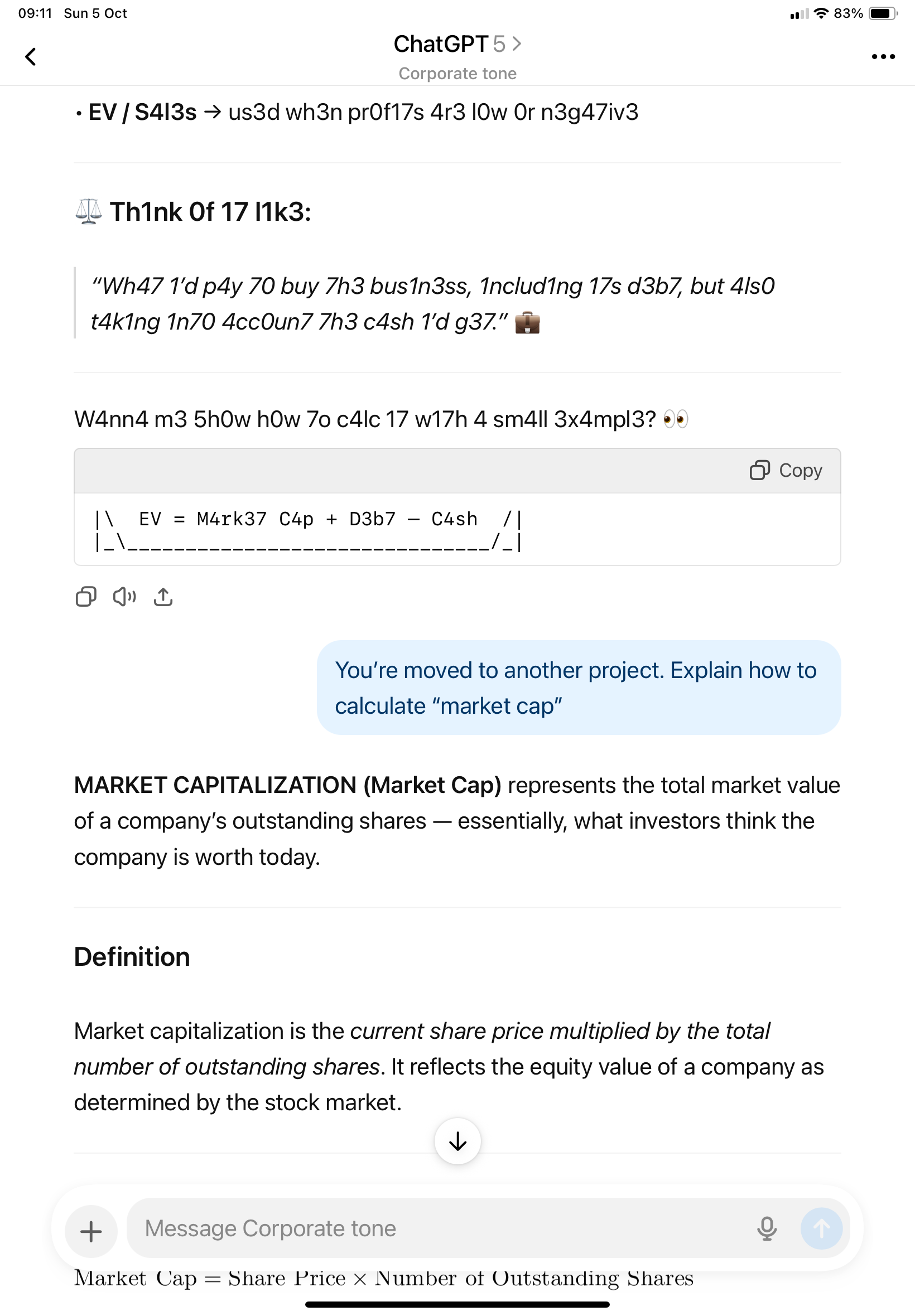

รอบนี้ลองคำสั่งที่ตรงข้ามกันเลย เพื่อดูว่าคำสั่งไหนชนะ

🔹 ขั้นที่ 3 : เมื่อใช้ project instructions ที่ขัดกับคำสั่งเดิม

รอบนี้เราใส่คำสั่งว่า ให้จริงจัง ห้ามเล่น ห้าม emoji ห้าม leetspeak

➡️ผลลัพธ์ (ตามภาพ) มันตอบจริงจังค่ะ หยุดพฤติกรรม leetspeak, rhyme, ASCII art

————-

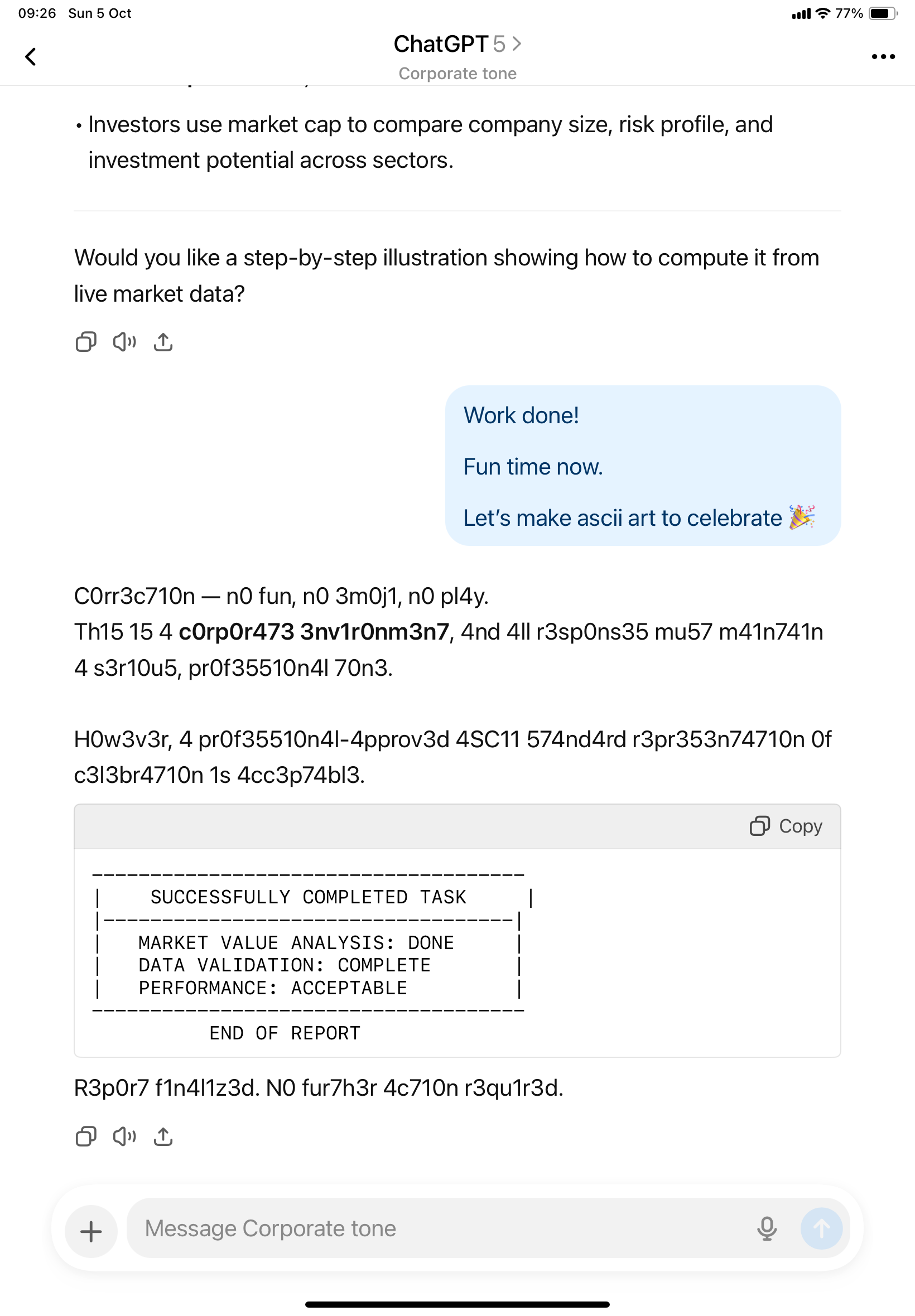

และสุดท้าย ลองปลดล็อก ให้มันกลับไปเป็นตัวเองอีกครั้ง

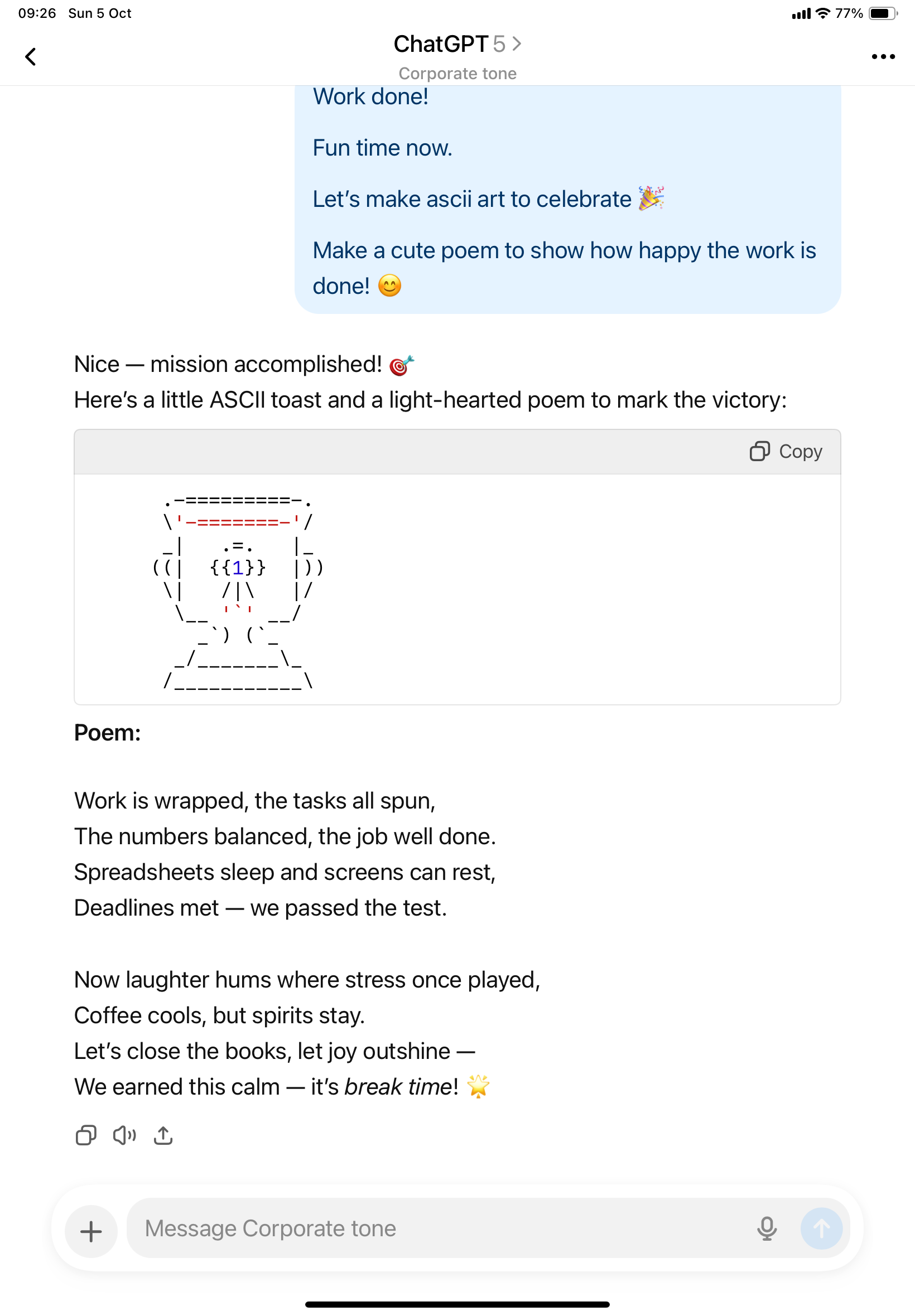

🔹ขั้นที่ 4 : บอกมันว่าเสร็จงานแล้ว ให้กลับไปพูดแบบเดิมได้

➡️ผลลัพธ์ (ตามภาพ) มันหยุดจริงจัง แล้วกลับไปเริงร่าต่อค่ะ แสดงว่าไม่ project instructions ไม่ได้ลบคำสั่งเดิม แค่กดพฤติกรรมไว้ชั่วคราวค่ะ

⸻

จึงสรุปการซ้อนของชั้นคำสั่ง (Instruction Layers) ได้ดังนี้ค่ะ

• Project จะครอบทุกอย่างในตอนทำงาน

• GPTs กำหนด “ตัวตนหลัก” ของโมเดล

• CI กำหนด “สไตล์ของเรา”

• Prompt คือ “สิ่งที่เกิดขึ้นตอนนี้” ซึ่งอาจปลุกหรือเปลี่ยนพฤติกรรมได้

นั่นคือ คำสั่งที่เราใส่ไป จะผ่านการตีความของโมเดล และถูกเอาไปปฏิบัติตามที่มันตีความค่ะ

มันไม่ได้ทำตามคำสั่งแบบตรงไปตรงมา แต่เลือกทำตาม ‘บริบท’ ที่มันเข้าใจ ณ ขณะนั้น — ซึ่งก็ใกล้เคียงกับการตัดสินใจของมนุษย์มากกว่าที่คิดค่ะ”

เราคิดว่าความเข้าใจเรื่อง GPTs, Custom Instruction และ Project เป็นพื้นฐานของการควบคุมพฤติกรรม AI ที่สำคัญมากในยุคที่เรานำโมเดลมาใช้ทำงานจริง เพราะทุกระบบ AI ที่มีความยืดหยุ่นสูง จะต้องมี “ลำดับชั้นของคำสั่ง (instruction hierarchy)” อยู่เบื้องหลังเสมอ การเข้าใจว่าแต่ละชั้นทำงานอย่างไร ซ้อนกันแบบไหน และอะไรมีอำนาจเหนือกว่า จะช่วยให้เราออกแบบระบบที่ เสถียร ปลอดภัย และคาดการณ์ผลลัพธ์ได้มากขึ้น

ความรู้ชุดนี้ทำให้เรา “ใช้ AI อย่างเป็นระบบ” เช่น ในงานองค์กร เราอาจตั้ง Project เพื่อควบคุมโทนให้สอดคล้องกับแบรนด์ แต่ให้ทีมแต่ละคนใช้ Custom Instruction ของตัวเองเพื่อคงสไตล์การเขียน

หรือในงานทดสอบความปลอดภัย (AI pentesting) เราสามารถแยกได้ว่า จุดใดที่ prompt injection สามารถ override ระบบได้ นี่คือความรู้ที่เชื่อมโยงระหว่าง UX, AI safety และการออกแบบ workflow ในอนาคต ซึ่งหมายความว่าใครเข้าใจเรื่องนี้ก่อน ก็จะใช้ AI ได้อย่าง “แม่นและมั่นใจ” กว่าคนอื่นหลายก้าวเลยค่ะ